Anthropic 堅持嚴格限制 AI 軍事用途,OpenAI 則以「合法用途」為框架與軍方簽約。這次事件凸顯 AI 倫理監管挑戰,並引發公眾對 AI 武器化的疑慮。Anthropic 堅持嚴格限制 AI 軍事用途,OpenAI 則以「合法用途」為框架與軍方簽約。這次事件凸顯 AI 倫理監管挑戰,並引發公眾對 AI 武器化的疑慮。

如需對本內容提供反饋或相關疑問,請通過郵箱 crypto.news@mexc.com 聯絡我們。

根據外媒報導,美國兩大 AI 新創 Anthropic 與 OpenAI 近期針對與國防部的合作模式產生嚴重歧見。Anthropic 執行長 Dario Amodei 在一份給員工的內部備忘錄中,批評 OpenAI 與軍方達成的協議僅是「安全戲法」,並質疑對方在技術監管上的透明度。 Amodei 主張, OpenAI 的合作條款並未能實質杜絕 AI 在監控與武器化方面的風險。

爭議核心在於雙方對美國國防部「不受限訪問技術」的不同反應,Anthropic 因堅持軍方必須書面承諾不將技術用於國內大規模監控與自主武器,最終未能與軍方達成共識;而 OpenAI 則隨後與國防部簽約。儘管 OpenAI 宣稱其合約同樣具備防護措施,且僅限於「合法用途」,但此說法遭到 Anthropic 質疑是為了規避更嚴格的倫理約束。

根據雙方公開與流出的訊息顯示,「合法性」的解讀成為焦點。

Anthropic 認為法律可能因政權更迭而改變,單純依賴「合法」一詞不足以保障技術安全。而 OpenAI 則在官方聲明中重申,其合約已將非法的監控行為明確排除在用途之外,並符合現行法規。

此事件已引發公眾對 AI 參與軍事用途的疑慮。第三方數據顯示,OpenAI 宣布該協議後,ChatGPT 的卸載率在短期內增長近三倍;Amodei 在內部信中指出,大眾對此交易的疑慮正反映在市場排名上,而 Anthropic 則因堅持倫理立場獲得更多認同。

核稿編輯:Mia

加入 INSIDE 會員,獨享 INSIDE 科技趨勢電子報,點擊立刻成為會員!

延伸閱讀:

- 替被美國政府列入黑名單的 Anthropic 求情?OpenAI 執行長 Altman 在打的算盤

- Anthropic 遭列國安風險名單:解析供應鏈風險爭議與 Claude 霸榜背後的隱私戰火

免責聲明: 本網站轉載的文章均來源於公開平台,僅供參考。這些文章不代表 MEXC 的觀點或意見。所有版權歸原作者所有。如果您認為任何轉載文章侵犯了第三方權利,請聯絡 crypto.news@mexc.com 以便將其刪除。MEXC 不對轉載文章的及時性、準確性或完整性作出任何陳述或保證,並且不對基於此類內容所採取的任何行動或決定承擔責任。轉載材料僅供參考,不構成任何商業、金融、法律和/或稅務決策的建議、認可或依據。

您可能也會喜歡

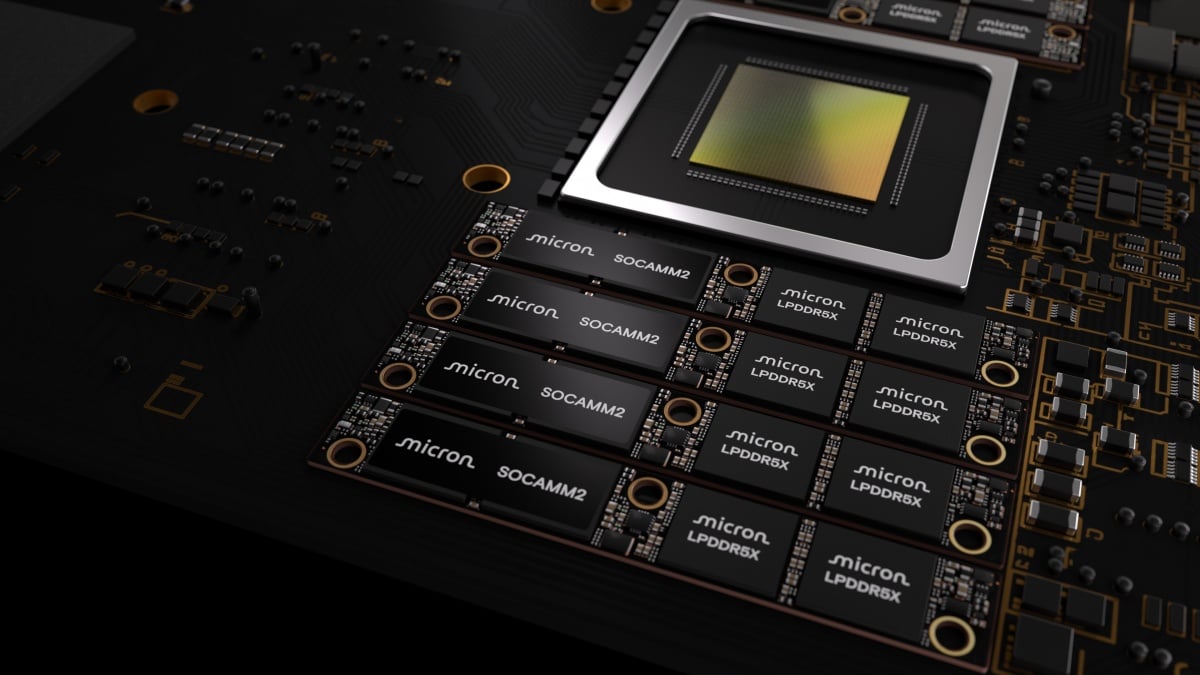

美光推出 256 GB SOCAMM2 模組 單 CPU 記憶體可達 2 TB

美光發表全球最大 256 GB SOCAMM2 記憶體模組,讓單 CPU 系統最高可達 2 TB 容量。美光宣佈,已經領先業界開始出樣目前全球最大容量的「256GB SOCAMM2」記憶體模組。這款專為資料中心打造的怪物級新品,首度採用全球首見的單晶片32Gb LPDDR5x DRAM裸晶 (Die)。這不僅大幅推升了

分享

Cool3c2026/03/05 13:36

台灣三星談 Galaxy S26 AI 競局 面對記憶體成本與 iPhone 壓力

為因應成本上揚與市場競爭,三星 Galaxy S26 將主打 AI 應用與高階市場。輔以預購優惠、N-1 機種銷售策略,力求銷量與銷額雙位數成長,並鞏固 Z 系列摺疊手機領導地位。

分享

Cool3c2026/03/05 13:23

聯發科 Breeze 3 模型支援台語理解 AI 能辨識台灣口音

聯發科發表 Breeze 3 系列,強化台語語音辨識與合成,並建構在地化 AI 安全防護。部分模型已開源,並於 LINE 開放體驗,持續深耕台灣 AI 生態。

分享

Cool3c2026/03/05 13:33